一、概述

1、Linux 是一个多任务操作系统,它支持远大于 CPU 数量的任务同时运行。当然,这些任务实际上并不是真的在同时运行,而是因为系统在很短的时间内,将 CPU 轮流分配给它们,造成多任务同时运行的错觉

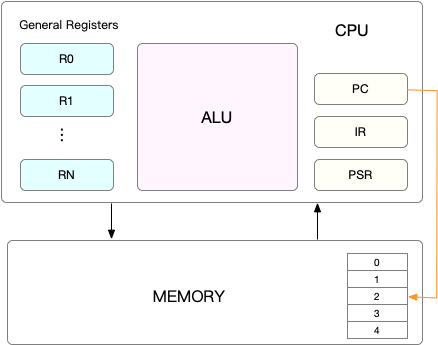

2、而在每个任务运行前,CPU 都需要知道任务从哪里加载、又从哪里开始运行,也就是说,需要系统事先帮它设置好 CPU 寄存器和程序计数器(Program Counter,PC)

3、CPU 寄存器,是 CPU 内置的容量小、但速度极快的内存。而程序计数器,则是用来存储 CPU 正在执行的指令位置、或者即将执行的下一条指令位置。它们都是 CPU 在运行任何任务前,必须的依赖环境,因此也被叫做 CPU 上下文。

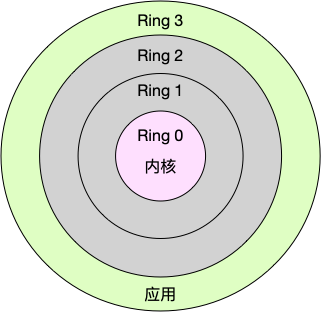

4、CPU 上下文切换:就是先把前一个任务的 CPU 上下文(也就是 CPU 寄存器和程序计数器)保存起来,然后加载新任务的上下文到这些寄存器和程序计数器,最后再跳转到程序计数器所指的新位置,运行新任务。(而这些保存下来的上下文,会存储在系统内核中,并在任务重新调度执行时再次加载进来。这样就能保证任务原来的状态不受影响,让任务看起来还是连续运行。)

5、场景分类:进程上下文切换、线程上下文切换以及中断上下文切换。

二、上下文切换理解

1、进程上下文切换

1)系统调用(特权模式切换)

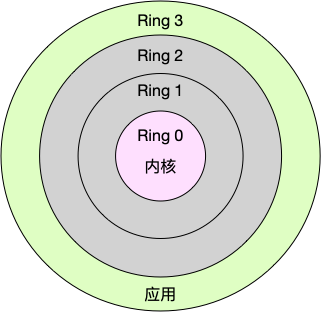

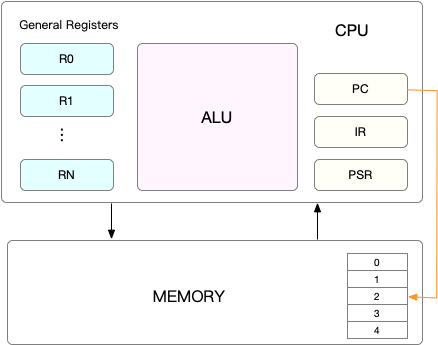

1、Linux 按照特权等级,把进程的运行空间分为内核空间和用户空间,分别对应着下图中, CPU 特权等级的 Ring 0 和 Ring 3。

* 内核空间(Ring 0)具有最高权限,可以直接访问所有资源;

* 用户空间(Ring 3)只能访问受限资源,不能直接访问内存等硬件设备,必须通过系统调用陷入到内核中,才能访问这些特权资源。

进程既可以在用户空间运行,又可以在内核空间中运行。进程在用户空间运行时,被称为进程的用户态,而陷入内核空间的时候,被称为进程的内核态。

2、系统调用:

从用户态到内核态的转变,需要通过系统调用来完成。比如,当我们查看文件内容时,就需要多次系统调用来完成:首先调用 open() 打开文件,然后调用 read() 读取文件内容,并调用 write() 将内容写到标准输出,最后再调用 close() 关闭文件。

3、系统调用中的CPU上下文切换:

* CPU 寄存器里原来用户态的指令位置,需要先保存起来。接着,为了执行内核态代码,

* CPU 寄存器需要更新为内核态指令的新位置。最后才是跳转到内核态运行内核任务。而系统调用结束后,CPU 寄存器需要恢复原来保存的用户态,然后再切换到用户空间,继续运行进程。所以,一次系统调用的过程,其实是发生了两次 CPU 上下文切换。

注:

系统调用过程中,并不会涉及到虚拟内存等进程用户态的资源,也不会切换进程。这跟我们通常所说的进程上下文切换是不一样的

故:

系统调用过程通常称为特权模式切换,而不是上下文切换。

4、总结:

* CPU 上下文切换,是保证 Linux 系统正常工作的核心功能之一,一般情况下不需要我们特别关注。

* 过多的上下文切换,会把 CPU 时间消耗在寄存器、内核栈以及虚拟内存等数据的保存和恢复上,从而缩短进程真正运行的时间,导致系统的整体性能大幅下降。

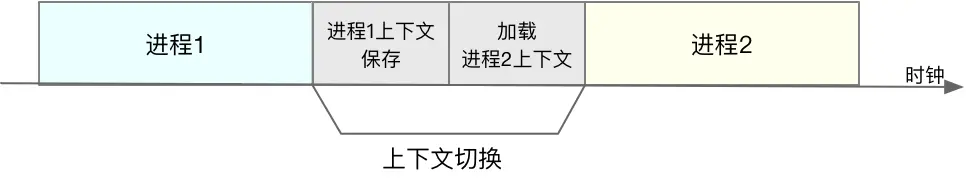

2)进程间上下文切换(通常理解的上下文切换)

1、上面说了系统调用是特权模式切换,下面对比这来理解下进程CPU切换

* 进程是由内核来管理和调度的,进程的切换只能发生在内核态。所以,进程的上下文不仅包括了虚拟内存、栈、全局变量等用户空间的资源,还包括了内核堆栈、寄存器等内核空间的状态。

* 进程的上下文切换就比系统调用时多了一步:在保存当前进程的内核状态和 CPU 寄存器之前,需要先把该进程的虚拟内存、栈等保存下来;而加载了下一进程的内核态后,还需要刷新进程的虚拟内存和用户栈。

2、进程上下文切换带来的影响:

* 每次上下文切换都需要几十纳秒到数微秒的 CPU 时间。这个时间还是相当可观的,特别是在进程上下文切换次数较多的情况下,很容易导致 CPU 将大量时间耗费在寄存器、内核栈以及虚拟内存等资源的保存和恢复上,进而大大缩短了真正运行进程的时间。这也正是上一节中我们所讲的,导致平均负载升高的一个重要因素。

* Linux 通过 TLB(Translation Lookaside Buffer)来管理虚拟内存到物理内存的映射关系。当虚拟内存更新后,TLB 也需要刷新,内存的访问也会随之变慢。特别是在多处理器系统上,缓存是被多个处理器共享的,刷新缓存不仅会影响当前处理器的进程,还会影响共享缓存的其他处理器的进程。

3、进程上下文切换的原因

进程切换时才需要切换上下文,换句话说,只有在进程调度的时候,才需要切换上下文。Linux 为每个 CPU 都维护了一个就绪队列,将活跃进程(即正在运行和正在等待 CPU 的进程)按照优先级和等待 CPU 的时间排序,然后选择最需要 CPU 的进程,也就是优先级最高和等待 CPU 时间最长的进程来运行。

3)进程上下文切换的几个场景

a、为了保证所有进程可以得到公平调度,CPU 时间被划分为一段段的时间片,这些时间片再被轮流分配给各个进程。这样,当某个进程的时间片耗尽了,就会被系统挂起,切换到其它正在等待 CPU 的进程运行。

b、进程在系统资源不足(比如内存不足)时,要等到资源满足后才可以运行,这个时候进程也会被挂起,并由系统调度其他进程运行。

c、当进程通过睡眠函数 sleep 这样的方法将自己主动挂起时,自然也会重新调度。

d、当有优先级更高的进程运行时,为了保证高优先级进程的运行,当前进程会被挂起,由高优先级进程来运行。

e、发生硬件中断时,CPU 上的进程会被中断挂起,转而执行内核中的中断服务程序。

2、线程上下文切换

1)进程与线程

a、线程与进程001:

线程与进程最大的区别在于,线程是调度的基本单位,而进程则是资源拥有的基本单位。其实,内核中的任务调度,实际上的调度对象是线程;而进程只是给线程提供了虚拟内存、全局变量等资源

b、线程与进程002:

* 当进程只有一个线程时,可以认为进程就等于线程。

* 当进程拥有多个线程时,这些线程会共享相同的虚拟内存和全局变量等资源。这些资源在上下文切换时是不需要修改的。

* 线程也有自己的私有数据,比如栈和寄存器等,这些在上下文切换时也是需要保存的。

2)线程上下文切换场景

a、前后两个线程属于不同进程。此时,因为资源不共享,所以切换过程就跟进程上下文切换是一样。

b、前后两个线程属于同一个进程。此时,因为虚拟内存是共享的,所以在切换时,虚拟内存这些资源就保持不动,只需要切换线程的私有数据、寄存器等不共享的数据。

注:

同进程内的线程切换,要比多进程间的切换消耗更少的资源,而这,也正是多线程代替多进程的一个优势。

3、中断上下文切换

1、为了快速响应硬件的事件,中断处理会打断进程的正常调度和执行,转而调用中断处理程序,响应设备事件。而在打断其他进程时,就需要将进程当前的状态保存下来,这样在中断结束后,进程仍然可以从原来的状态恢复运行。

2、跟进程上下文不同,中断上下文切换并不涉及到进程的用户态。所以,即便中断过程打断了一个正处在用户态的进程,也不需要保存和恢复这个进程的虚拟内存、全局变量等用户态资源。中断上下文,其实只包括内核态中断服务程序执行所必需的状态,包括 CPU 寄存器、内核堆栈、硬件中断参数等。

3、对同一个 CPU 来说,中断处理比进程拥有更高的优先级,所以中断上下文切换并不会与进程上下文切换同时发生。同样道理,由于中断会打断正常进程的调度和执行,所以大部分中断处理程序都短小精悍,以便尽可能快的执行结束。

4、另外,跟进程上下文切换一样,中断上下文切换也需要消耗 CPU,切换次数过多也会耗费大量的 CPU,甚至严重降低系统的整体性能。所以,当发现中断次数过多时,就需要注意去排查它是否会给你的系统带来严重的性能问题。

三、CPU上下文切换分析

过多的上下文切换,会把 CPU 时间消耗在寄存器、内核栈以及虚拟内存等数据的保存和恢复上,缩短进程真正运行的时间,成了系统性能大幅下降的元凶,下面我们来分析一波。

1、分析工具

1)vmstat

a、vmstat 是一个常用的系统性能分析工具,主要用来分析系统的内存使用情况,也常用来分析 CPU 上下文切换和中断的次数。

b、使用示例

# 每隔5秒输出1组数据

[root@172-16-104-112 ~]# vmstat 5

procs -----------memory---------- ---swap-- -----io---- -system-- ------cpu-----

r b swpd free buff cache si so bi bo in cs us sy id wa st

1 0 0 15322076 2240 627128 0 0 0 28 2 2 0 0 100 0 0

其中:

* cs(context switch)是每秒上下文切换的次数。

* in(interrupt)则是每秒中断的次数。

* r(Running or Runnable)是就绪队列的长度,也就是正在运行和等待 CPU 的进程数。

* b(Blocked)则是处于不可中断睡眠状态的进程数。

可以看到,这个例子中的上下文切换次数 cs 是 2 次,而系统中断次数 in 则是 2 次,而就绪队列长度 r 是 1 次,不可中断状态进程数 b 是 0。

2)pidstat

a、vmstat 只给出了系统总体的上下文切换情况,要想查看每个进程的详细情况,就需要使用我们前面提到过的 pidstat 了。给它加上 -w 选项,你就可以查看每个进程上下文切换的情况了。

b、使用示例

# 每隔5秒输出1组数据

[root@172-16-104-112 ~]# pidstat -w 5

Linux 3.10.0-1127.el7.x86_64 (172-16-104-112) 2021年12月17日 _x86_64_ (8 CPU)

09时57分06秒 UID PID cswch/s nvcswch/s Command

09时57分11秒 0 9 6.56 0.00 rcu_sched

09时57分11秒 0 11 0.20 0.00 watchdog/0

其中:

* cswch:表示每秒自愿上下文切换(voluntary context switches)的次数

* nvcswch:表示每秒非自愿上下文切换(non voluntary context switches)的次数。

注:

* 自愿上下文切换,是指进程无法获取所需资源,导致的上下文切换。比如说, I/O、内存等系统资源不足时,就会发生自愿上下文切换。

* 非自愿上下文切换,则是指进程由于时间片已到等原因,被系统强制调度,进而发生的上下文切换。比如说,大量进程都在争抢 CPU 时,就容易发生非自愿上下文切换。

2、案例分析

1)sysbench

sysbench 是一个多线程的基准测试工具,一般用来评估不同系统参数下的数据库负载情况

2)操作分析

a、以2000个线程运行5分钟的基准测试,模拟多线程切换的问题

[root@172-16-104-112 ~]# sysbench --threads=2000 --max-time=300 threads run

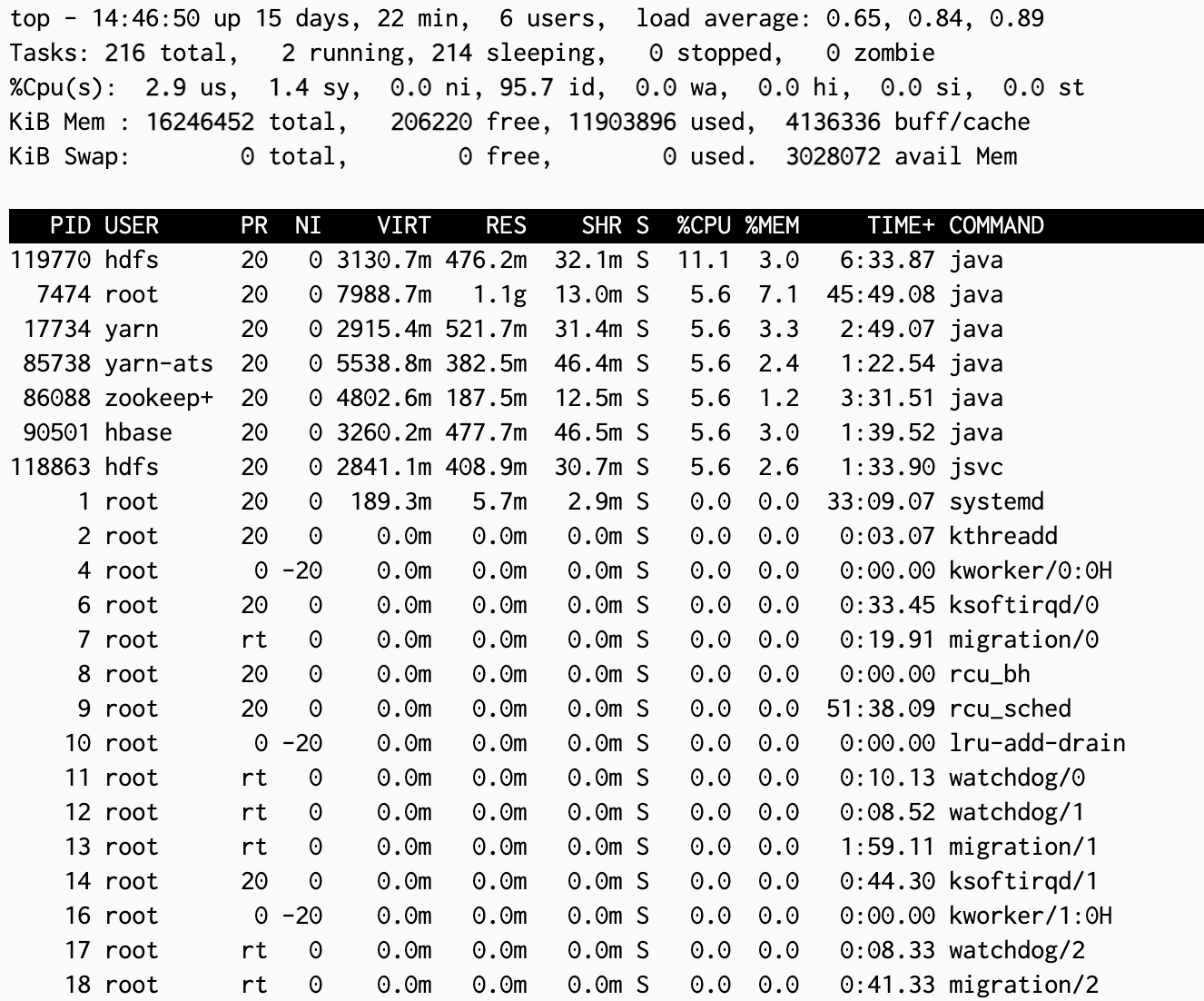

b、vmstat:观察上下文切换情况

# 每隔1秒输出1组数据(需要Ctrl+C才结束)

[root@172-16-104-112 ~]# vmstat 1

procs -----------memory---------- ---swap-- -----io---- -system-- ------cpu-----

r b swpd free buff cache si so bi bo in cs us sy id wa st

15 0 0 15199916 2252 663536 0 0 0 27 1 2 0 0 100 0 0

19 0 0 15199824 2252 663536 0 0 0 0 162385 2560976 25 57 18 0 0

13 0 0 15199576 2252 663536 0 0 0 0 166912 2648662 25 57 18 0 0

15 0 0 15199576 2252 663536 0 0 0 0 175238 2599956 25 56 18 0 0

分析:

cs 列:是每秒上下文切换的次数达到250万+;

in 列:中断次数也上升到了 16 万+,说明中断处理也是个潜在的问题

r 列:就绪队列的长度已经到了 15哥左右,远远超过了系统 CPU 的个数 8,所以肯定会有大量的 CPU 竞争。

c、pidstat:观察CPU 和进程上下文切换的情况

us(user)和 sy(system)列:这两列的 CPU 使用率加起来上升到了 100%,其中系统 CPU 使用率,也就是 sy 列高达 84%,说明 CPU 主要是被内核占用了。

# 每隔1秒输出1组数据(需要 Ctrl+C 才结束)

# -w参数表示输出进程切换指标,而-u参数则表示输出CPU使用指标

[root@172-16-104-112 ~]# pidstat -w -u 1

Linux 3.10.0-1127.el7.x86_64 (172-16-104-112) 2021年12月18日 _x86_64_ (8 CPU)

00时38分19秒 UID PID %usr %system %guest %CPU CPU Command

00时38分20秒 0 59748 100.00 100.00 0.00 100.00 0 sysbench

00时38分19秒 UID PID cswch/s nvcswch/s Command

00时38分20秒 0 1 1.00 0.00 systemd

00时38分20秒 0 6 8.00 0.00 ksoftirqd/0

00时38分20秒 0 9 27.00 0.00 rcu_sched

00时38分20秒 0 11 1.00 0.00 watchdog/0

00时38分20秒 0 12 1.00 0.00 watchdog/1

00时38分20秒 0 14 4.00 0.00 ksoftirqd/1

00时38分20秒 0 17 1.00 0.00 watchdog/2

00时38分20秒 0 19 2.00 0.00 ksoftirqd/2

00时38分20秒 0 22 1.00 0.00 watchdog/3

00时38分20秒 0 27 1.00 0.00 watchdog/4

00时38分20秒 0 29 3.00 0.00 ksoftirqd/4

00时38分20秒 0 32 1.00 0.00 watchdog/5

00时38分20秒 0 37 1.00 0.00 watchdog/6

00时38分20秒 0 42 1.00 0.00 watchdog/7

00时38分20秒 0 744 1.00 0.00 irqbalance

00时38分20秒 0 1109 1.00 0.00 rsyslogd

00时38分20秒 0 16311 1.00 0.00 kworker/3:2

00时38分20秒 0 16347 2.00 0.00 kworker/4:0

00时38分20秒 0 17558 1.00 0.00 kworker/6:1

00时38分20秒 0 55397 5.00 0.00 kworker/0:0

00时38分20秒 0 55594 12.00 0.00 sshd

00时38分20秒 0 57397 118.00 0.00 kworker/4:1

00时38分20秒 0 61752 1.00 118.00 pidstat

分析:

CPU 使用率的升高果然是 sysbench 导致的,它的 CPU 使用率已经达到了 100%。但上下文切换则是来自其他进程,包括非自愿上下文切换频率最高的 pidstat ,以及自愿上下文切换频率最高的内核线程 kworker 和 sshd。

# 每隔1秒输出一组数据(需要 Ctrl+C 才结束)

# -wt 参数表示输出线程的上下文切换指标

[root@172-16-104-112 ~]# pidstat -wt 1

Linux 3.10.0-1127.el7.x86_64 (172-16-104-112) 2021年12月18日 _x86_64_ (8 CPU)

平均时间: UID TGID TID cswch/s nvcswch/s Command

平均时间: 0 - 59583 313.56 1028.33 |__sysbench

平均时间: 0 - 59584 399.27 1230.51 |__sysbench

平均时间: 0 - 59585 305.57 662.71 |__sysbench

平均时间: 0 - 59586 329.06 1012.11 |__sysbench

平均时间: 0 - 59587 362.71 1307.26 |__sysbench

平均时间: 0 - 59588 370.94 696.13 |__sysbench

平均时间: 0 - 59589 238.26 440.44 |__sysbench

平均时间: 0 - 59590 252.54 619.61 |__sysbench

平均时间: 0 - 59591 262.23 582.57 |__sysbench

平均时间: 0 - 59592 358.11 1153.27 |__sysbench

平均时间: 0 - 59593 417.68 1093.46 |__sysbench

平均时间: 0 - 59594 364.16 1126.39 |__sysbench

分析:

上下文切换罪魁祸首,还是过多的 sysbench 线程。

3、小总

a、这个数值其实取决于系统本身的 CPU 性能。如果系统的上下文切换次数比较稳定,那么从数百到一万以内,都应该算是正常的。但当上下文切换次数超过一万次,或者切换次数出现数量级的增长时,就很可能已经出现了性能问题。

b、上下文切换的类型

* 自愿上下文切换变多了,说明进程都在等待资源,有可能发生了 I/O 等其他问题;

* 非自愿上下文切换变多了,说明进程都在被强制调度,也就是都在争抢 CPU,说明 CPU 的确成了瓶颈;

* 中断次数变多了,说明 CPU 被中断处理程序占用,还需要通过查看 /proc/interrupts 文件来分析具体的中断类型。