Hive小文件合并

hive 小文件合并

一、参数配置:

在Map输入的时候, 把小文件合并.

-- 每个Map最大输入大小,决定合并后的文件数 set mapred.max.split.size=256000000; -- 一个节点上split的至少的大小 ,决定了多个data node上的文件是否需要合并 set mapred.min.split.size.per.node=100000000; -- 一个交换机下split的至少的大小,决定了多个交换机上的文件是否需要合并 set mapred.min.split.size.per.rack=100000000; -- 执行Map前进行小文件合并 set hive.input.format=org.apache.hadoop.hive.ql.io.CombineHiveInputFormat;

在Reduce输出的时候, 把小文件合并.

-- 在map-only job后合并文件,默认true set hive.merge.mapfiles = true; -- 在map-reduce job后合并文件,默认false set hive.merge.mapredfiles = true; -- 合并后每个文件的大小,默认256000000 set hive.merge.size.per.task = 256000000; -- 平均文件大小,是决定是否执行合并操作的阈值,默认16000000 set hive.merge.smallfiles.avgsize = 100000000;

Hadoop的归档文件格式

set hive.archive.enabled= true ; set hive.archive.har.parentdir.settable= true ; set har.partfile.size=1099511627776; ALTER TABLE srcpart ARCHIVE PARTITION(ds= '2008-04-08' , hr= '12' ); ALTER TABLE srcpart UNARCHIVE PARTITION(ds= '2008-04-08' , hr= '12' );

二、sql合并:

concatenate

--对于非分区表 alter table tablename concatenate; --对于分区表 alter table tablename partition(dt=20201224) concatenate;

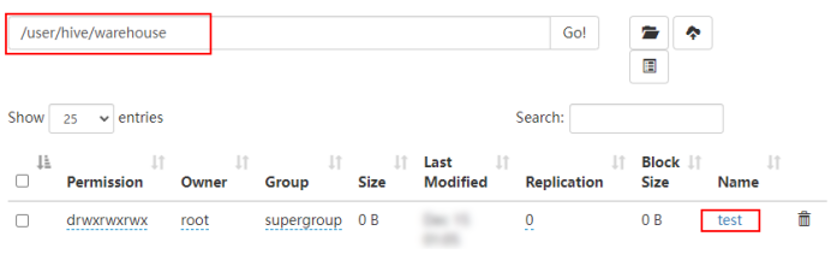

insert overwrite

--select 的字段需要自己拼起来,select * 的话,由于带有dt字段,无法写入新分区。 insert overwrite table tableName partition(dt=2022031100) select column1,column2 from tableName where dt=2022031100 insert overwrite select * --用这个方法就能去掉分区表的日期字段 set hive.support.quoted.identifiers=none; insert overwrite test1 select (字段)?+.+ from test;