HBase 的 BulkLoad 机制

1.概述

在实际生产环境中,有这样一种场景:用户数据位于HDFS中,业务需要定期将这部分海量数据导入 HBase 系统,以执行随机查询更新操作。这种场景如果调用写入 API 进行处理,极有可能会给 RegionServer 带来较大的写人压力:

l 引起 RegionServer 频繁 flush,进而不断 compact、split,影响集群稳定性。

l 引起 RegionServer 频繁GC,影响集群稳定性。

l 消耗大量 CPU 资源、带宽资源、内存资源以及 IO 资源,与其他业务产生资源竞争。

l 在某些场景下,比如平均 KV 大小比较大的场景,会耗尽 RegionServer 的处理线程, 导致集群阻塞。

鉴于存在上述问题,HBase提供了另一种将数据写入HBase集群的方法一BulkLoad。

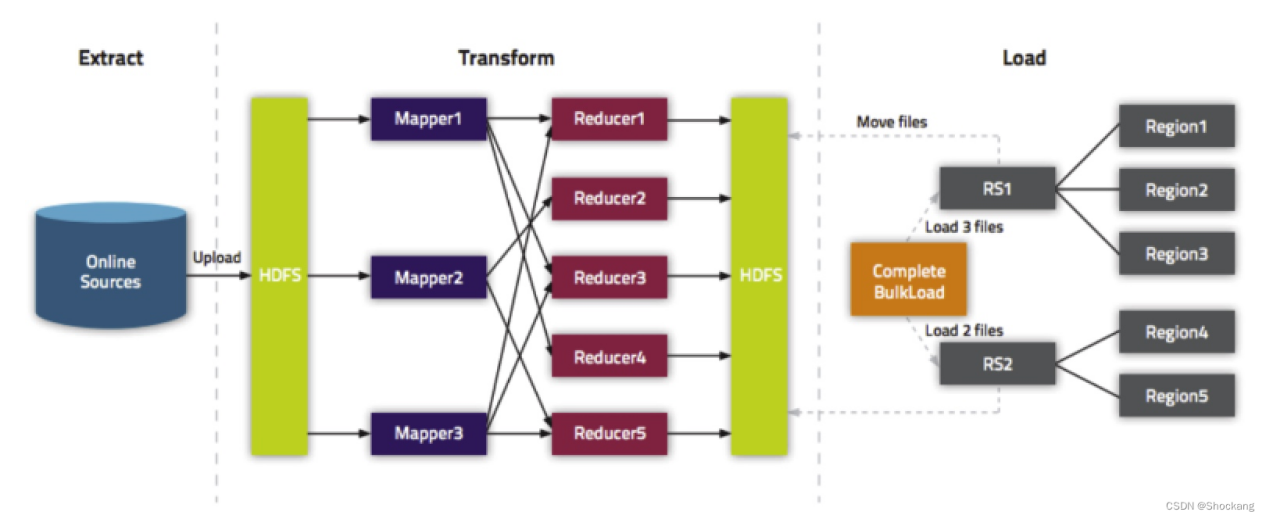

BulkLoad 首先使用 MapReduce 将待写入集群数据转换为 HFile 文件,再直接将这些 HFile 文件加载到在线集群中。显然,BulkLoad 方案没有将写请求发送给 RegionServer 处理,可以有效避免上述一系列问题。

2.BulkLoad 核心流程

从 HBase 的视角来看,BulkLoad 主要由两个阶段组成:

2.1HFile 生成阶段

这个阶段会运行一个 MapReduce 任务,MapReduce 的 mapper 需要自己实现,将 HDFS 文件中的数据读出来组装成一个复合 KV,其中 Key 是 rowkey, Value 可以是 KeyValue 对象、Put 对象甚至 Delete 对象;

MapReduce 的 reducer 由 HBase 负责,通过方法 HFileOutputFormat2.configureIncrementalLoad() 进行配置,这个方法主要负责以下事项。

l 根据表信息配置一个全局有序的 partitioner。

l 将 partitioner 文件上传到 HDFS 集群并写入 DistributedCache.

l 设置 reduce task 的个数为目标表 Region 的个数。

l 设置输出 key/value 类满足 HFileOutputFormat 所规定的格式要求。

l 根据类型设置 reducer 执行相应的排序(Key ValueSortReducer或者PutSortReducer)。这个阶段会为每个Region生成一个对应的HFile文件。

2.2HFile 导入阶段

HFile 准备就绪之后,就可以使用工具 completebulkload 将HFile 加载到在线HBase集群。

completebulkload 工具主要负责以下工作:

l 依次检查第一步生成的所有 HFile 文件,将每个文件映射到对应的 Region。

l 将 HFile 文件移动到对应 Region 在的 HDFS 文件目录下。

l 告知 Region 对应的 RegionServer,加载 HFile 文件对外提供服务。

如果在 BulkLoad 的中间过程中 Region 发生了分裂,completebulkload工具会自动将对应的 HFile 文件按照新生成的 Region 边界切分成多个 HFile 文件,保证每个 HFile 都能与目标表当前的 Region 相对应。但这个过程需要读取 HFile 内容,因而并不高效。需要尽量减少 HFile 生成阶段和 HFile 导入阶段的延迟,最好能够在 HFile 生成之后立刻执行 HFile 导入。

基于 BulkLoad 两阶段的工作原理,BulkLoad的核心流程如图所示。

Shell-bulkload

文本文件--->MR--->Hfile--->load到表指定的目录

1.准备数据

hdfs dfs -mkdir /csv

vi friends.csv

1,zss,23,m

2,lss,33,m

3,fj,35,f

4,ny,42,m

5,xq,44,f

hdfs dfs -put friends.csv /csv/

2.在hbase中创建表

create 'tb_friends' , 'cf'

3.使用shell命令将数据转换成hfile文件

hbase org.apache.hadoop.hbase.mapreduce.ImportTsv \ --使用类执行操作

-Dimporttsv.separator=, \

-Dimporttsv.columns='HBASE_ROW_KEY,cf:name,cf:age,cf:gender' \

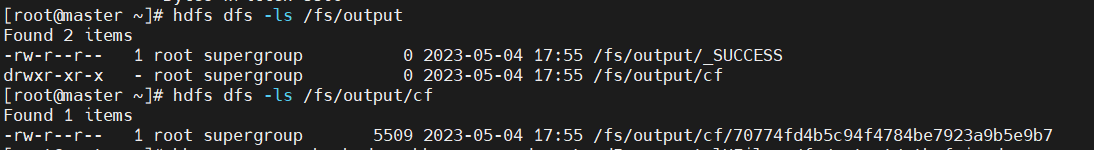

-Dimporttsv.bulk.output=/fs/output \

tb_friends \ --hbase表

/csv/friends.csv --输入的文件路径

此时表tb_friends还没有数据

4.将Hfile文件导入表中

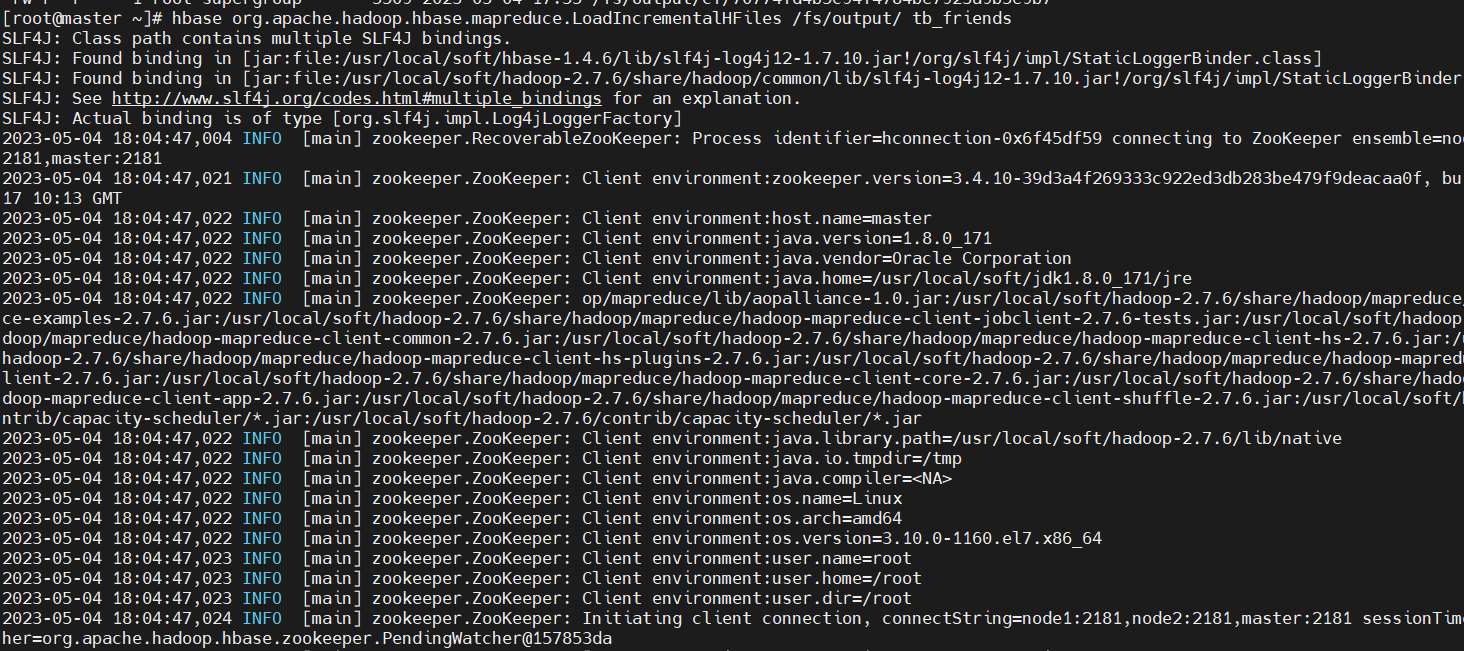

hbase org.apache.hadoop.hbase.mapreduce.LoadIncrementalHFiles /fs/output/ tb_friends

查看hbase表数据